你有没有遇到过这种情况:

和 AI 聊了很长一段时间,突然它开始"忘事"了——之前说好的要求不记得了,前面提到的背景信息不知道跑哪去了,甚至开始自相矛盾。

或者相反:你在一个全新的对话窗口里问它之前聊过的内容,它一问三不知,就像初次见面一样。

这背后的核心概念,就是上下文(Context)。

理解了上下文,你就理解了大语言模型最底层的工作方式之一。

一、上下文是什么?

用一个最简单的比喻来解释:

想象你和一个朋友在聊天。你们聊了半小时,这段时间里说的所有话,就是你们之间的"上下文"。你们能互相理解、接着之前的话题往下聊,是因为双方都记得这段对话的内容。

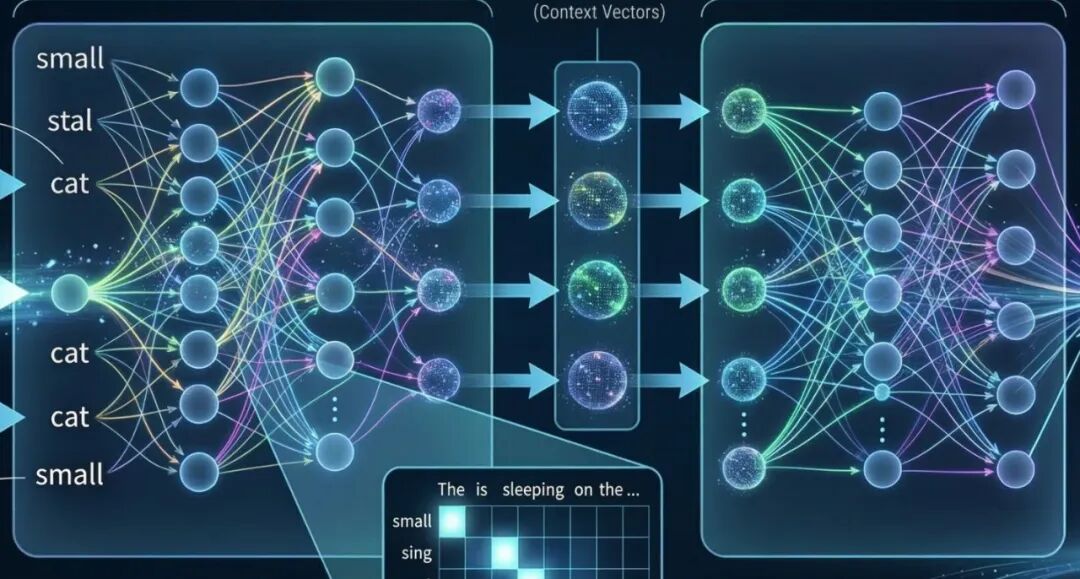

大语言模型的"上下文",本质上就是它在回答你这个问题之前,能看到的所有文字信息。

具体包括:

-

你之前说的所有内容

-

AI 之前回复的所有内容

-

系统预设的角色定义或规则(如果有的话)

每次你发送一条消息,模型并不是只看你刚才说的那句话,而是把整段对话历史 全部读一遍,然后再给出回复。

这就是为什么你在前面提到"我是一个初学者,请用简单的语言解释",后面它还能保持通俗的风格——因为每次回答,它都重新读了一遍你们之间所有的对话。

二、上下文窗口:AI 的"短期记忆上限"

既然模型每次都要读整段对话,那能读多长?

这就引出了一个关键概念:上下文窗口(Context Window)。

你可以把它理解成 AI 的"桌面大小"。桌面越大,能摆的东西越多;桌面太小,东西多了就放不下,只能把旧的推到地上。

上下文窗口的大小,通常用 Token 来衡量。Token 是模型处理文字的基本单位,大致上:

-

1 个英文单词 ≈ 1-2 个 Token

-

1 个中文字 ≈ 1-2 个 Token

不同模型的上下文窗口大小不同。早期的模型只有几千个 Token,现在的主流模型普遍达到了 10 万、20 万甚至更多 Token——大约相当于一本中等厚度的书。

窗口满了会怎样?

当对话内容超过上下文窗口的上限,模型就会开始"遗忘"——通常是把最早的对话内容丢掉,只保留最近的部分。这就是为什么聊了很久之后,AI 会忘记你最开始说的事情。

这不是 bug,是模型的物理限制。

三、上下文为什么这么重要?

理解了上下文是什么,再来看它为什么重要。

1. 上下文决定了 AI 理解你的能力

同样一句话,在不同的上下文里意思可能完全不同。

比如你问:"它靠谱吗?"

如果之前的对话是在讨论一款软件,AI 会理解成"这款软件靠谱吗"。如果之前在聊一个人,AI 会理解成"这个人靠谱吗"。

AI 没有真正的"理解",它只是在上下文里寻找线索,推断你的意图。上下文越丰富、越清晰,它的判断就越准确。

2. 上下文决定了对话的连贯性

这也是为什么在同一个对话窗口里,你不需要每次都重复背景信息;但如果开了新窗口,就要重新说明一遍。

两个窗口之间,上下文是完全隔离的,模型没有任何跨窗口的记忆。

3. 上下文影响输出质量

做同一件事,给的上下文越充分,结果往往越好。

让 AI 帮你写一篇文章,如果只说"写一篇关于健康饮食的文章",结果会很泛。但如果你在上下文里提供了目标读者、文章风格、字数要求、要避免的内容……AI 输出的结果就会精准得多。

上下文的质量,直接决定了 AI 输出的质量。

四、怎么用好上下文?

知道了上下文的原理,有几个实用的技巧可以帮你更好地使用 AI 工具。

技巧一:在对话开头把背景说清楚

不要让 AI 猜你是谁、想要什么。直接在开头说清楚:你的身份、你的目标、你的限制条件。这些信息会贯穿整个对话,AI 每次回答都会参考。

比如:"我是一个没有编程基础的产品经理,我想了解 API 是什么,请用非技术的语言解释。"

技巧二:长对话要主动做"上下文整理"

如果对话进行了很长时间,可以主动总结一下之前达成的共识,让 AI 在新的"起点"继续工作。比如:"我们前面已经确定了以下几点:……接下来请基于这些继续。"

这样即使早期内容被"推出桌面",核心信息也被保留在了近期的上下文里。

技巧三:新任务开新窗口

如果你要做一个和之前完全不相关的任务,建议开一个新的对话窗口。旧的上下文可能会干扰新任务,导致 AI 的回答受到无关信息的影响。

技巧四:上下文要精,不要多

有人以为塞给 AI 的信息越多越好,其实不然。无关的信息会稀释有效信息,让模型搞不清楚重点在哪里。上下文要精准,只提供真正相关的内容。

五、上下文的边界:AI 真的"记得"你吗?

最后,有一个常见的误解值得澄清。

很多人觉得和 AI 聊久了,AI 就"认识"自己了,会记得自己的习惯和喜好。

事实上,大多数 AI 应用的上下文只在当次对话 内有效。关掉窗口、开始新对话,之前的一切都消失了。AI 并没有一个持久的"记忆库"在后台积累你的信息。

当然,一些产品在应用层做了"记忆"功能,会把你的偏好单独存储,在下次对话时重新注入上下文。但这是产品功能,不是模型本身的能力。

从本质上说,大语言模型是无状态的——每次对话,它都是一张白纸。它所有的"记忆",都来自当前这次对话的上下文。

结语

上下文,是你和 AI 沟通的共同语言。

它不神秘,就是"AI 在回答你之前,能看到的所有内容"。理解了这一点,你就会明白为什么有时候 AI 会"忘事",为什么同样的问题在不同情境下会得到不同的回答,以及怎样组织信息才能让 AI 更好地帮到你。

用好上下文,是用好 AI 的第一步,也是最重要的一步。

下次和 AI 对话之前,不妨先想想:我给它的上下文,够清晰吗?